Les Réseaux de Neurones Artificiels (RNA) : Fondements et Applications

Les réseaux de neurones artificiels (RNA), ou Artificial Neural Networks (ANN) en anglais, sont des modèles computationnels conçus pour simuler le fonctionnement des réseaux neuronaux biologiques. Ils constituent l’une des pierres angulaires de l’apprentissage automatique (machine learning) et sont à la base des avancées majeures dans le domaine de l’intelligence artificielle (IA), notamment dans l’apprentissage profond (deep learning).

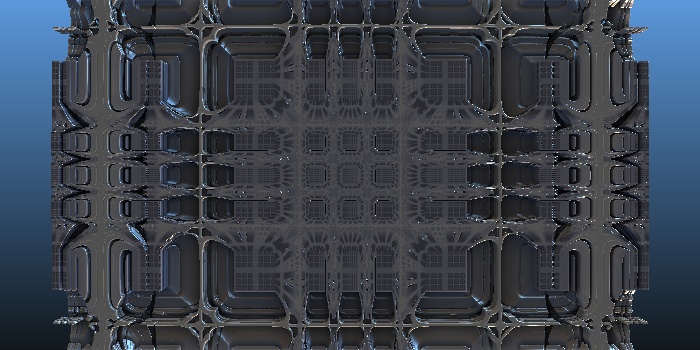

1. Architecture d’un réseau de neurones

Un RNA se compose de couches de neurones artificiels interconnectés :

- La couche d’entrée reçoit les données brutes (ex. : pixels d’une image, valeurs numériques, textes vectorisés).

- Les couches cachées réalisent des transformations successives des données à travers des opérations linéaires et non linéaires. Le nombre et la profondeur de ces couches déterminent la capacité du modèle à capturer des relations complexes.

- La couche de sortie fournit le résultat final (ex. : classe prédite, valeur estimée).

Chaque neurone calcule une sortie en appliquant une fonction d’activation (ReLU, sigmoïde, tanh, etc.) à une combinaison linéaire des entrées pondérées. Les poids synaptiques et les biais associés sont les paramètres appris par le modèle.

2. Mécanisme d’apprentissage

L’apprentissage supervisé d’un RNA suit généralement deux phases :

- Propagation avant (forward pass) : les données circulent à travers le réseau et produisent une sortie.

- Rétropropagation de l’erreur (backpropagation) : l’erreur entre la sortie prédite et la sortie réelle est calculée à l’aide d’une fonction de coût (par exemple, l’erreur quadratique moyenne ou l’entropie croisée). Un algorithme d’optimisation, typiquement la descente de gradient stochastique (SGD) ou ses variantes (Adam, RMSProp), ajuste ensuite les poids pour minimiser cette erreur.

Ce processus est répété sur un ensemble de données d’entraînement jusqu’à convergence.

3. Capacités et applications

Les RNA sont capables d’approximer des fonctions non linéaires complexes, ce qui les rend adaptés à une grande variété de tâches :

- Classification (ex. : reconnaissance d’images, détection de spams)

- Régression (ex. : prédiction de cours boursiers)

- Traitement du langage naturel (traduction automatique, analyse de sentiments)

- Reconnaissance vocale et faciale

- Conduite autonome et robotique

L’essor du deep learning a été rendu possible grâce à l’augmentation de la puissance de calcul (GPU), la disponibilité de grandes quantités de données (big data), et l’amélioration des algorithmes d’optimisation.

4. Limites et enjeux

Malgré leurs performances remarquables, les RNA présentent plusieurs limites :

- Dépendance aux données : ils requièrent de vastes jeux de données annotées pour être efficaces.

- Boîte noire : leur interprétabilité reste limitée, rendant difficile l’explication des décisions.

- Risque de surapprentissage (overfitting) : en particulier sur des jeux de données réduits ou bruités.

- Coût computationnel élevé, tant pour l’entraînement que pour l’inférence.

5. Perspectives

Les recherches actuelles visent à améliorer l’efficacité énergétique, la robustesse aux attaques adverses, et l’explicabilité des modèles. L’intégration des RNA dans des systèmes hybrides combinant logique symbolique et apprentissage statistique constitue également une voie prometteuse. |